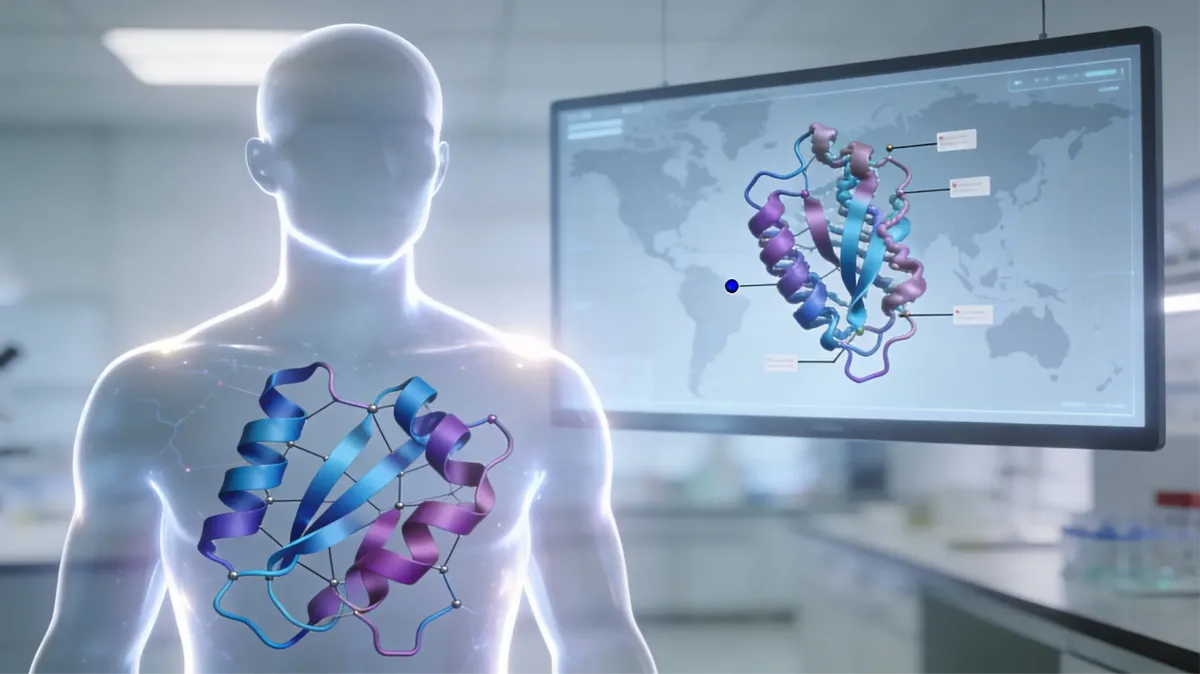

AlphaFold: mapea proteínas y acelera nuevos tratamientos de salud

Una parte enorme de la medicina moderna se decide lejos de los hospitales: el momento en que un equipo entiende “a qué” atacar dentro del cuerpo o de un virus. AlphaFold, la IA de Google DeepMind, ayuda justo ahí: predice la forma 3D de proteínas y las publica en una biblioteca abierta gestionada junto a EMBL‑EBI, que ya supera los 214 millones de modelos. En 2025 sumó una mejora simple de explicar —poder hacer anotaciones sobre esas estructuras— que vuelve más rápido el trabajo cotidiano que, con el tiempo, alimenta nuevos diagnósticos y tratamientos.